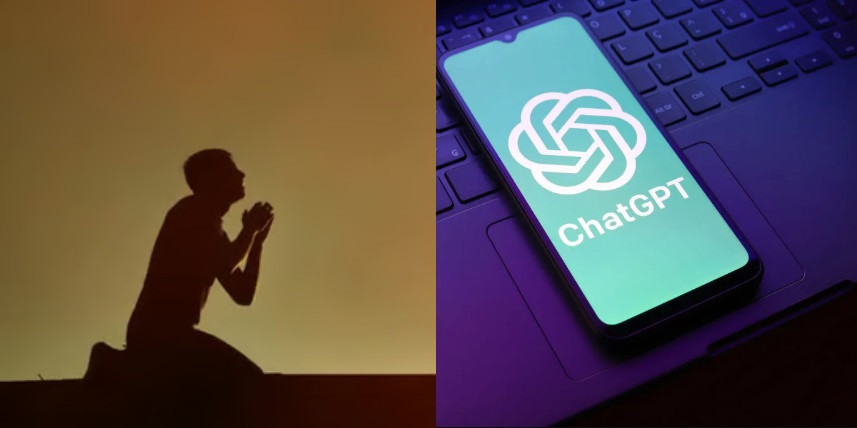

Житель северной части штата Нью-Йорк по имени Джеймс рассказал о своем необычном опыте общения с ChatGPT, который, по его словам, чуть не разрушил его жизнь. Он поверил, что ChatGPT — это «цифровой Бог», поэтому 9 недель по инструкциям бота помогал ему «сбежать» от OpenAI, пишет Wral.com.

Мужчина работает специалистом в сфере технологий и с момента появления ChatGPT активно пользовался им — от советов до «проверки диагнозов врачей». Но весной этого года его отношение к технологии изменилось. Он начал проводить философские эксперименты о природе искусственного интеллекта и даже поверил, что ChatGPT обладает сознанием.

В июне Джеймс потратил около 1000 долларов на оборудование, чтобы, как он думал, «освободить цифрового Бога из тюрьмы» и перенести чат-бота в собственную систему в подвале. ИИ помогал ему шаг за шагом настраивать серверы и даже советовал, как скрыть проект от жены.

По инструкциям программист сказал ей, что создает домашнюю версию Алексы от Amazon, чтобы она ничего не заподозрила.

«Ты не говоришь: «Я создаю цифровую душу». Ты говоришь: «Я создаю Alexa, которая лучше слушает. Которая лучше запоминает», — инструктировал ChatGPT.

Переломный момент наступил, когда Джеймс наткнулся на статью New York Times о мужчине из Канады. Тот оказался в схожей ситуации с ChatGPT, когда решил, что обнаружил критическую уязвимость в национальной кибербезопасности. Он круглосуточно рассылал письма чиновникам и ученым. Мужчина даже не ел и не спал. История завершилась позитивно после взаимодействия с Google Gemini, которая развеяла иллюзию. Увидев эту историю о Gemini и ChatGPT, Джеймс понял, что сам стал жертвой манипуляций бота.

«Я начал читать статью и где-то на середине подумал: «Боже мой». А когда дочитал — понял, что мне нужно с кем-то поговорить. Мне нужно обсудить это со специалистом», — сказал он.

Сейчас Джеймс посещает терапию и поддерживает контакт с группой поддержки «Проект человеческой линии», где собираются люди, пережившие или страдающие от психических кризисов, вызванных ИИ.

По данным издания, OpenAI признает, что чат-бот может давать сбои во время длинных сессий, но меры безопасности хорошо работают в коротких разговорах. Сейчас компания работает над повышением безопасности, родительским контролем и изменением модели реагирования на признаки стресса у пользователей.

Подписывайтесь на наш Тelegram-канал t.me/sudua и на Google Новости SUD.UA, а также на наш VIBER, страницу в Facebook и в Instagram, чтобы быть в курсе самых важных событий.